YH002 Mezzanine Сервер 768ГБ

GPUs

8

GPU

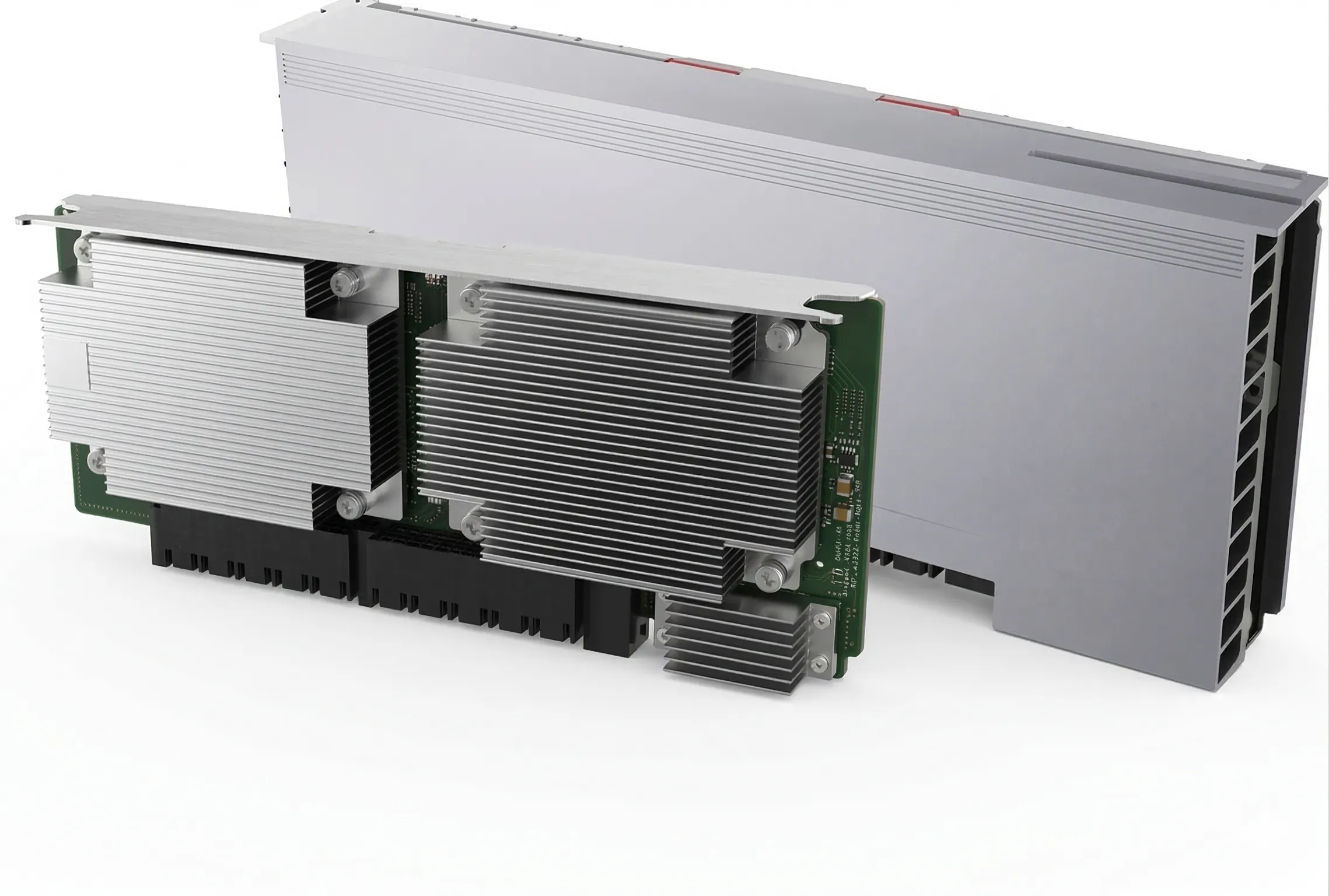

YH002 Module 96GB

Производитель

Компания YH — это китайский производитель специализированных AI-чипов на архитектуре RISC-V, ориентированный на облачные вычисления и энергоэффективные ускорители для LLM Их AI-чип нового поколения, спроектированный как основа для облачных вычислений и работы с крупными языковыми моделями (LLM). Это не просто ускоритель, а полноценная архитектурная платформа, где упор сделан на эффективность матричных операций, масштабируемость и гибкость под кастомные AI-нагрузки. В основе лежит гибридный подход к ISA: используется RISC-V (base) с векторным расширением RVV, дополненный кастомными матричными инструкциями и собственной виртуальной архитектурой команд (VISA). Это даёт ключевое преимущество — возможность тонкой настройки под конкретные модели и алгоритмы, в отличие от фиксированных ISA в традиционных GPU. С точки зрения вычислений чип построен по TPU-подобной архитектуре: внутри реализованы двойные systolic array-матрицы, оптимизированные под плотные линейные алгебраические операции, характерные для LLM и deep learning. Дополняет это высокопроизводительный 4D DMA-движок, который решает одну из главных проблем современных ускорителей — узкое место при перемещении данных. В результате достигается высокая эффективность как в compute, так и в data movement. Отдельный акцент сделан на оптимизации под большие модели, в частности под архитектуры уровня DeepSeek. Поддерживается формат Blocked FP8 — это позволяет существенно снизить требования к памяти и повысить throughput без критичной потери точности, что особенно важно при инференсе и обучении больших моделей. Для масштабирования используется собственный интерконнект ELink. Он позиционируется как альтернатива NVIDIA NVLink и ориентирован на построение крупных кластеров с поддержкой In-Network Computing. Это означает, что часть вычислений может выполняться прямо на уровне сети, снижая latency и разгружая сами чипы. В целом, это специализированный AI-чип для датацентров, заточенный под: крупные языковые модели (LLM), распределённое обучение, высоконагруженный inference, построение масштабируемых AI-кластеров. Ключевая идея — уйти от универсальности GPU в сторону глубокой вертикальной оптимизации под AI-нагрузки, где важны не только FLOPS, но и эффективность работы с памятью, сетью и кастомными форматами данных.

Продуктов

4

GPUs

8

GPU

YH002 Module 96GB

GPUs

8

GPU

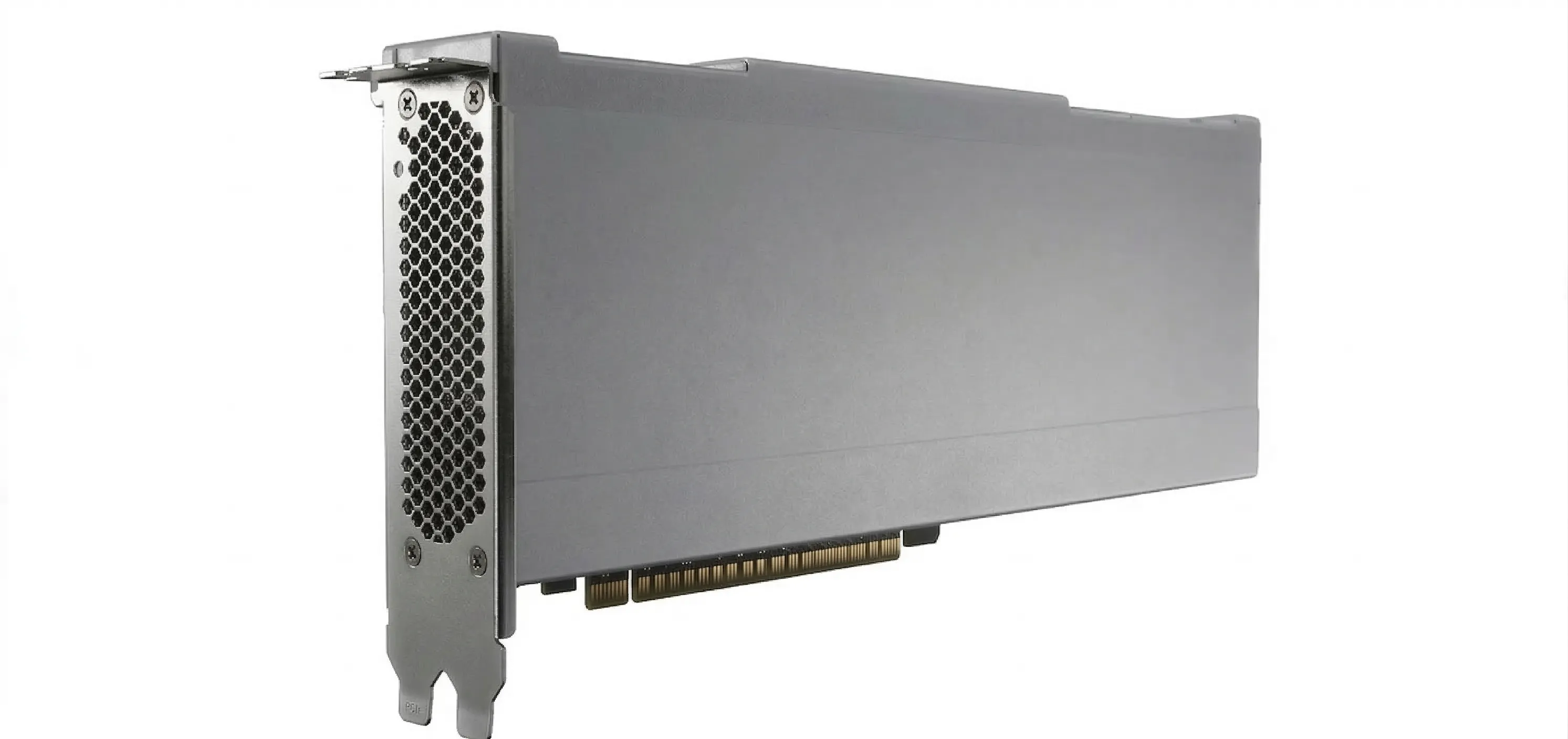

YH001 PCIe 48GB

VRAM

96

ARCH

TPU Архитектура

VRAM

48

ARCH

TPU Архитектура